随着社交媒体、监控视频和各种流媒体平台的发展,视频内容正在以惊人的速度增长。每个人几乎每天都会接触大量视频,而如何从这些海量视频中提取有用的信息,尤其是精准分析视频中的人类行为,成了科技界的一个难题。过去,分析人类行为的技术常常依赖复杂的模板和单张图片进行逐帧分析,既麻烦又不太可靠。那么,有没有一种更简单、更智能的解决方案呢?德国图宾根大学的研究团队给出了答案——InterTrack。

传统方法的局限

早期的视频分析方法通常需要为每个物体提前设计模板,这不仅需要耗费大量时间和精力,还要求技术人员具备较高的专业知识。而且这些方法往往只能依赖单张图片进行分析,无法捕捉到视频中连续的动作,导致在处理动态视频时,效果不尽人意。

这种局限性在如今的视频数据时代显得尤为突出。举个简单的例子,想象一下,在一个有遮挡物的监控画面中追踪一个人物的行为,如果只依赖单张图片,系统就可能误判,导致追踪失败。而这些问题正是InterTrack想要解决的核心。

InterTrack的突破

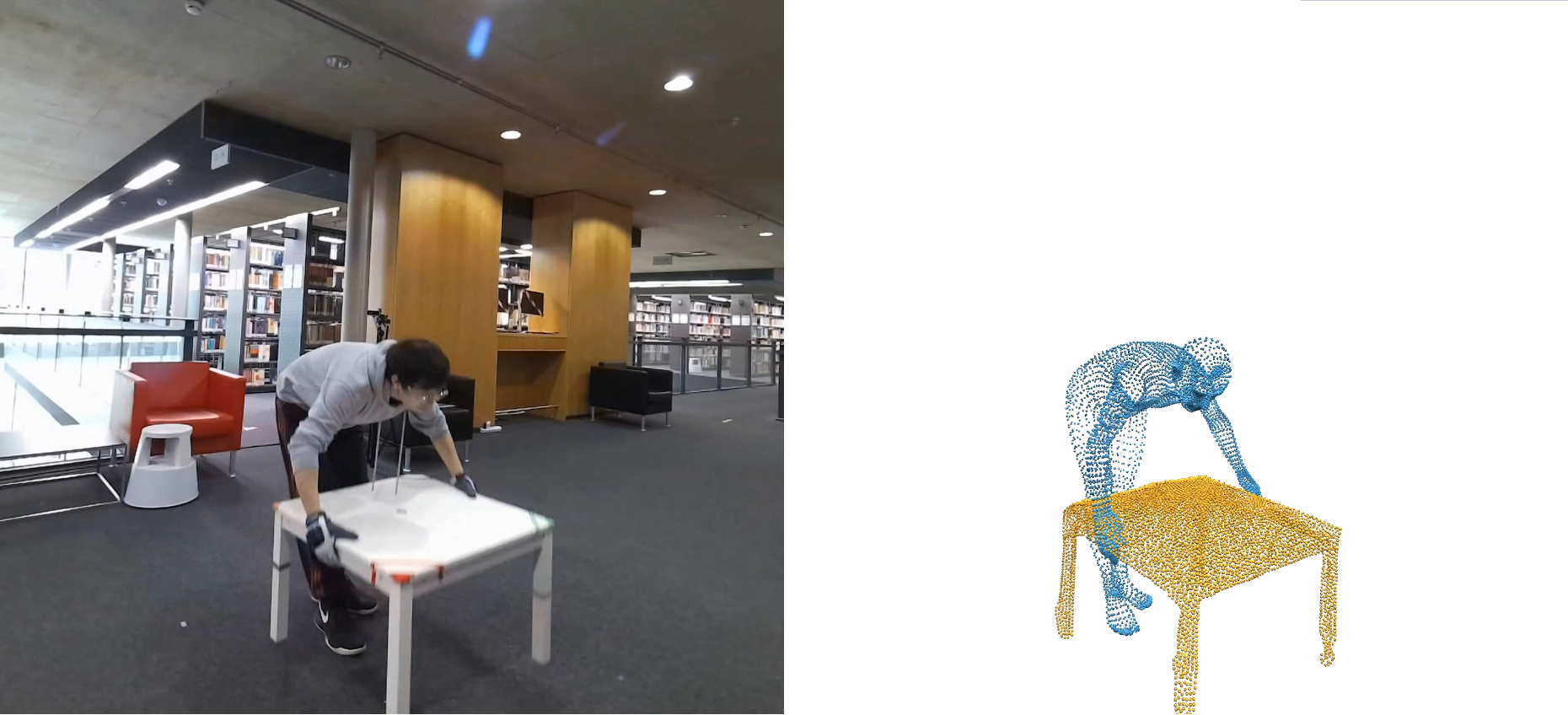

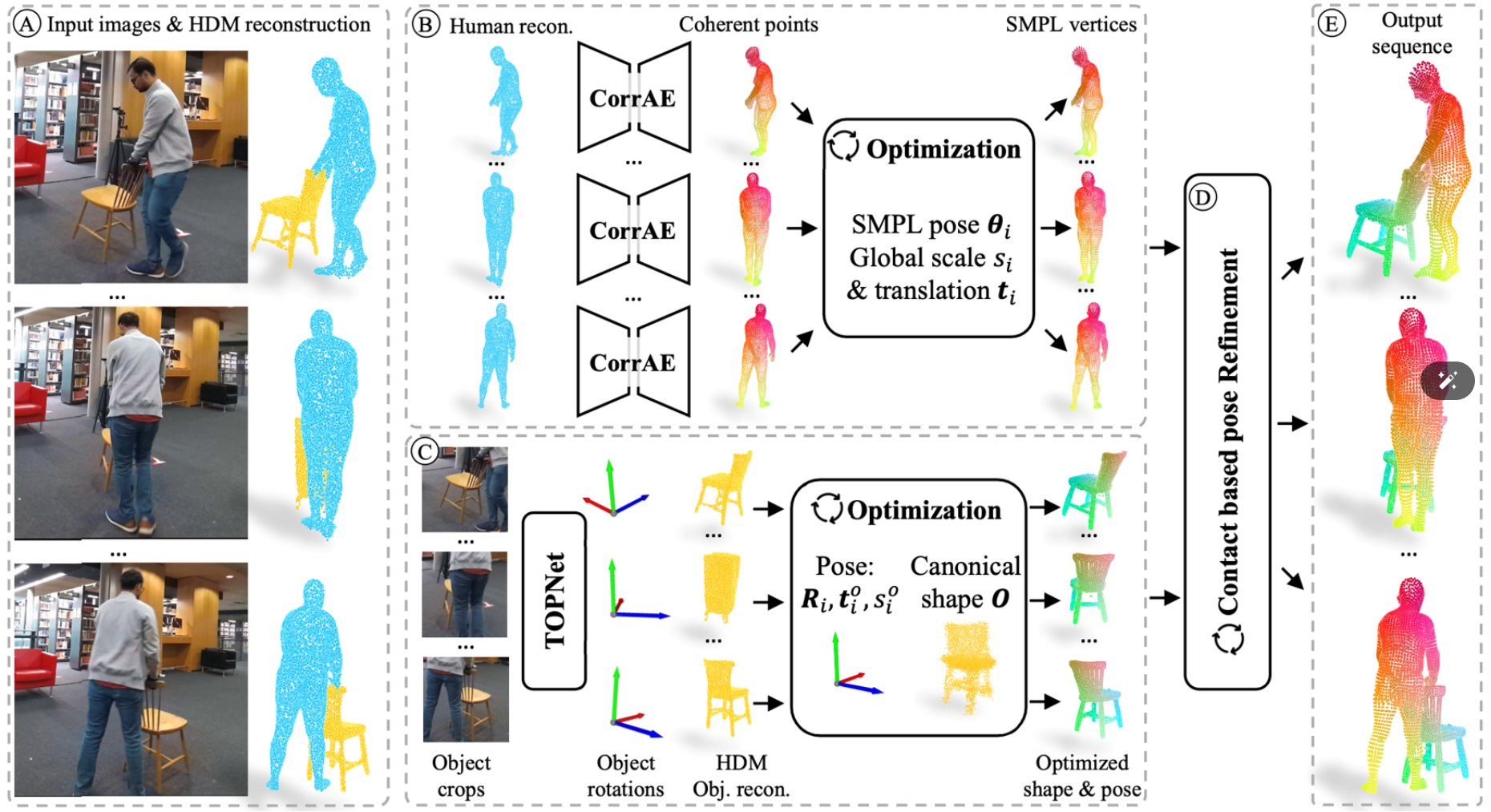

InterTrack是一种全新的追踪技术,不再依赖繁琐的模板,也不用逐帧设置。在这一创新方法中,研究人员将复杂的四维追踪问题简化为两大步骤:

第一步,逐帧追踪人类的动作,确保对每个动作的捕捉准确到位;

第二步,优化物体与人物的形状模型,即使物体被部分遮挡,系统依然能够保持对它的平滑追踪。

InterTrack还采用了一种高效的自编码器技术,这种技术能够保证人类动作在视频中的连贯性,不会因为场景切换或者物体遮挡而导致分析中断。此外,物体的姿态预测器也能在复杂环境下,确保对物体旋转的精准预测。无论是人物动作还是物体运动,都能够在视频中得到自然流畅的展现。

训练数据的创新

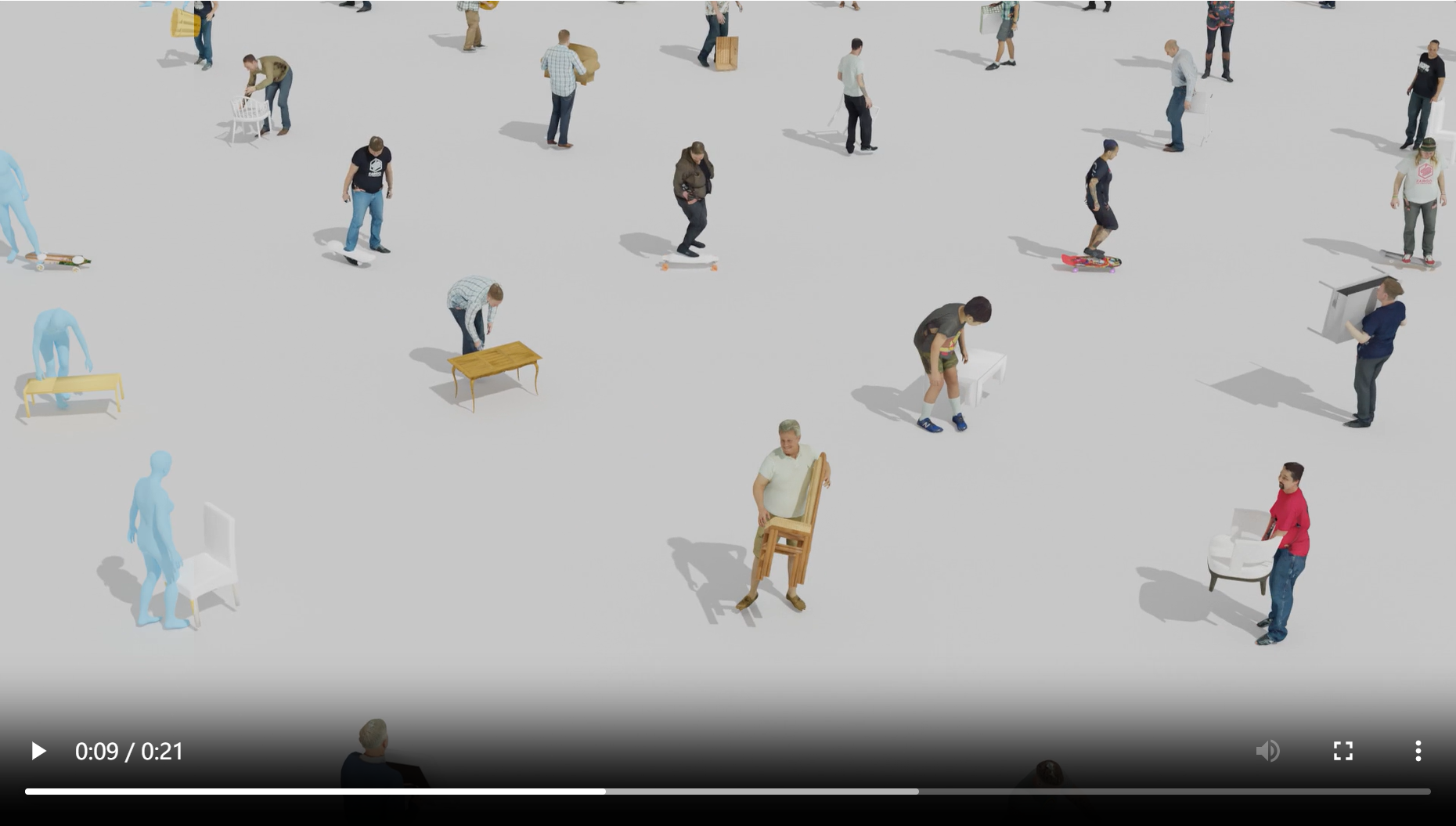

为了训练出如此强大的模型,InterTrack研发团队创造了一个名为ProciGen-Video的数据集。这个数据集涵盖了超过10小时的互动视频序列,展示了8500个人与4500种不同物体的互动场景。通过这种庞大的数据集,InterTrack的模型能够适应各种不同的场景,无论是商场监控、体育比赛,还是自动驾驶中的人车互动,InterTrack都能轻松应对。

更重要的是,InterTrack的这种创新式训练方法,为未来的视频技术发展提供了丰富的素材。其他基于视频的技术也可以利用这个数据集进行训练和优化,从而提升在实际应用中的表现。

对比传统方法

与以往的HDM方法相比,InterTrack最大的优势在于它能够持续追踪形状和姿态。传统的HDM方法在不同帧之间会出现形状不一致的情况,导致跟踪失误。而InterTrack则通过优化形状模型,确保在整个视频过程中形状和动作的连贯性,即使物体或人物在某些帧被遮挡,也不会影响整体的跟踪效果。

举个简单的例子,如果你在监控一场足球比赛时,球员一度被其他球员挡住,传统技术可能会短暂“丢失”这个球员的踪迹。但InterTrack则能在这个过程中,依然顺畅地预测出球员的运动轨迹,不会因为遮挡而中断分析。这一功能使InterTrack在许多需要持续跟踪的应用场景中表现得尤为出色。

InterTrack的应用前景

InterTrack不仅仅是一种学术研究成果,它的应用前景广阔。从安全监控到体育赛事分析,再到虚拟现实中的人物互动,InterTrack可以帮助我们更准确、更高效地理解视频中的人类行为。尤其是在未来的智能城市和无人驾驶等场景中,这种技术可以有效提升系统的自动化水平和决策能力。